引言

想用顶级大模型写代码、做推理,但不想每月烧几百块的 API 费用?好消息是,DeepSeek TUI + NVIDIA NIM 这套组合正好可以满足需求——前者是一个跑在终端里的 AI Coding Agent,后者提供完全免费的模型 API,Kimi K2.6、DeepSeek V4 Pro 等旗舰模型全都可以零成本调用。

这篇文章会从零开始,带你完成安装、配置到实战的全流程。

一、DeepSeek TUI 是什么?

简单说,DeepSeek TUI 是一个跑在终端里的原生 AI 编程智能体。它用 Rust 编写,单二进制文件即可运行,没有任何运行时依赖。你不用打开 VS Code 或任何重型 IDE,直接在命令行里让它读代码、改文件、跑命令、查问题。

核心特性一览:

多模式交互:支持 Normal、Plan、Agent、YOLO 等多种模式,从手动审批到全自动执行随意切换

全场景工具链:文件读写/编辑/搜索、Shell 命令执行、Web 搜索、Git 集成,一应俱全

子智能体并行:支持多任务并行调度,复杂项目可以拆解执行

MCP 协议支持:可以接入外部工具服务器,扩展能力极强

100 万 Token 超长上下文:配合 DeepSeek V4 系列模型,处理大型代码库毫无压力

最重要的是——DeepSeek TUI 支持多种 API 后端,除了 DeepSeek 官方 API 之外,还可以接入 NVIDIA NIM、Fireworks 或自托管的 SGLang,完全不需要 DeepSeek 平台账单。对我们来说,这意味着可以白嫖 NVIDIA 的免费算力。

二、NVIDIA NIM:免费调用顶级模型的正确姿势

2.1 NVIDIA NIM 是什么?

NVIDIA NIM(NVIDIA Inference Microservices)是英伟达推出的 AI 推理平台,整合了 120+ 款主流模型,通过统一的 OpenAI 兼容 API提供服务。更关键的是,NVIDIA 为开发者提供了完全免费的 API 调用额度,不限 Token、无需信用卡、不用代理。

2.2 免费额度有多大?

速率限制:大模型约 40 RPM,小模型约 60 RPM

每日请求:大模型约 1000 次/天,小模型约 14400 次/天

注册即送:1000 inference credits,可申请扩展至上限 5000 credits

API Key 有效期:最长可达 12 个月,到期可续

用途限制:仅限开发/原型验证,不适合生产级高并发场景

结论:40 RPM 对于个人日常使用完全够用——正常聊天节奏就是每分钟 1-2 次请求。

2.3 值得关注的免费模型

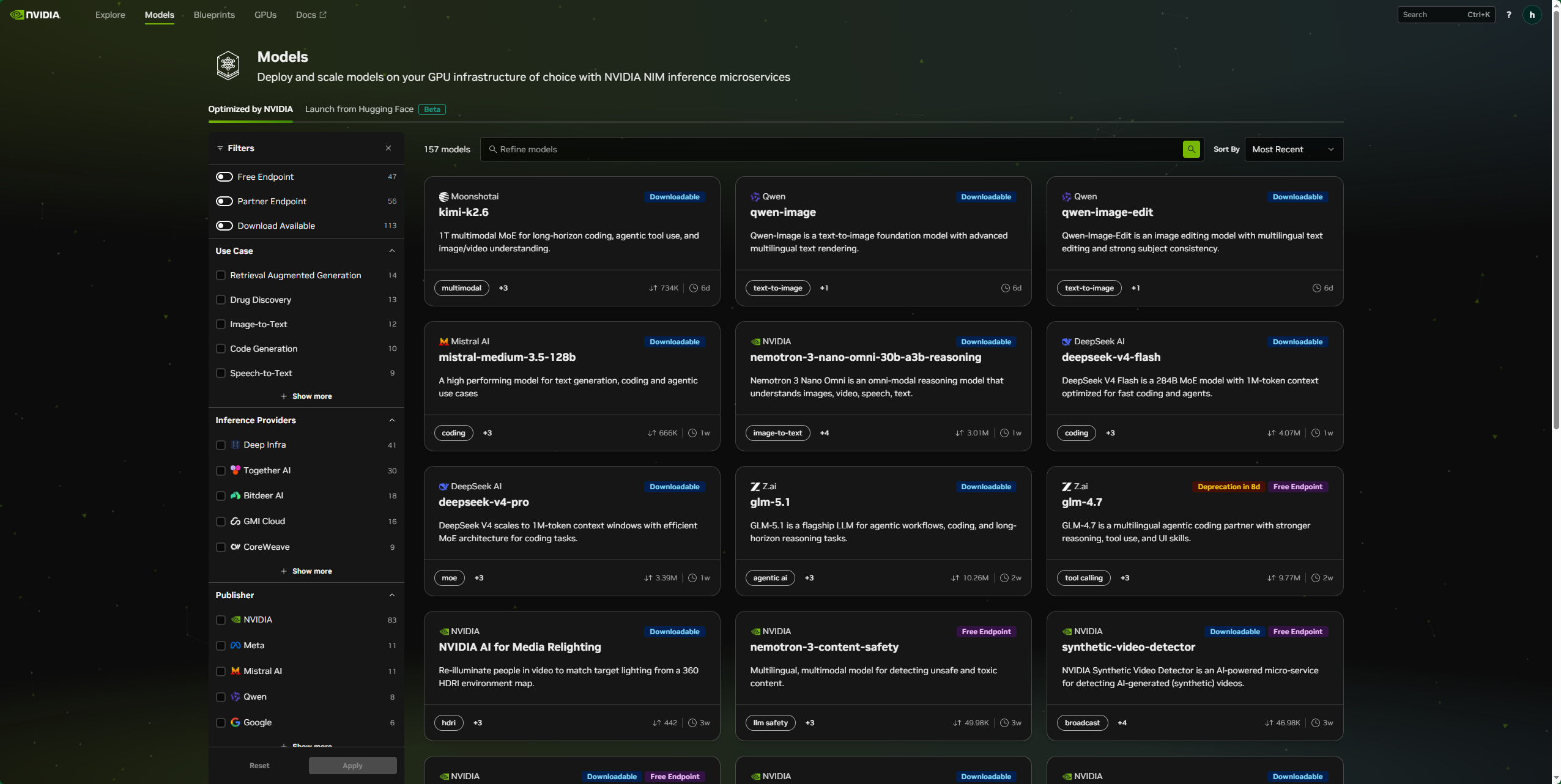

NIM 平台目前有 136 个可用模型,覆盖 20+ 组织。和本文主题最相关的几款:

完整列表可以用 API 直接拉取,访问

https://integrate.api.nvidia.com/v1/models即可看到所有可用模型。

三、手把手实战:从零搭建 DeepSeek TUI + NVIDIA NIM

3.1 第一步:获取 NVIDIA NIM API Key

打开

build.nvidia.com注册 NVIDIA 账号(支持 Google / GitHub 登录,国内邮箱也可以)

登录后,点击右上角头像 → API Keys → Generate API Key

选择

Never Expire,生成的 Key 以nvapi-开头复制 Key 并妥善保存,刷新后将不可再查看

至此 API Key 到手,接下来装工具。

3.2 第二步:安装 DeepSeek TUI

目前有 npm 和 Cargo 两条安装路径,新手推荐 npm:

方式 1:Cargo 安装(推荐,需 Rust 1.85+)

# 安装Rust(已安装可跳过)

curl --proto '=https' --tlsv1.2 -sSf https://sh.rustup.rs | sh

source $HOME/.cargo/env

# 安装DeepSeek TUI

cargo install deepseek-tui --locked

方式 2:源码编译安装

# 克隆仓库

git clone https://github.com/Hmbown/DeepSeek-TUI.git

cd DeepSeek-TUI

# 编译安装

cargo install --path . --locked

方式 3:直接下载预编译二进制

访问 GitHub Releases 页面(https://github.com/Hmbown/DeepSeek-TUI/releases ),下载对应系统的二进制文件,添加到系统 PATH 即可使用。

验证安装

# 查看版本

deepseek-tui --version

# 查看帮助

deepseek-tui --help

四、第三步:配置 DeepSeek TUI 对接 NVIDIA NI

3.3 第三步:配置接入 NVIDIA NIM

DeepSeek TUI 的配置文件位于 ~/.deepseek/config.toml。首次启动会自动引导配置,也可以手动创建。关键就是把 Base URL 和 API Key 指向 NVIDIA NIM,同时指定你想用的模型:

# ~/.deepseek/config.toml

# 默认配置

api_key = "nvapi-你的NVIDIA_API_KEY"

base_url = "https://integrate.api.nvidia.com/v1"

model = "moonshotai/kimi-k2.6"

max_tokens = 4096

thinking = false

effort = 3

# 也可以配置多个 profile,按需切换

[profiles.kimi]

api_key = "nvapi-你的NVIDIA_API_KEY"

base_url = "https://integrate.api.nvidia.com/v1"

model = "moonshotai/kimi-k2.6"

[profiles.deepseek]

api_key = "nvapi-你的NVIDIA_API_KEY"

base_url = "https://integrate.api.nvidia.com/v1"

model = "deepseek-ai/deepseek-v4-pro"参数说明:

base_url:固定填写https://integrate.api.nvidia.com/v1,这是 NVIDIA NIM 的 OpenAI 兼容端点model:填写完整的模型 ID,格式为组织名/模型名使用 profile 切换模型时,在启动命令中加

--profile kimi或按Ctrl+K打开命令面板选择

也可以不用配置文件,直接设置环境变量覆盖:

export DEEPSEEK_API_KEY=nvapi-xxx && export DEEPSEEK_BASE_URL=https://integrate.api.nvidia.com/v1 && deepseek

3.4 模型速查表

3.5 三步验证配置

# 1. 用 curl 快速测试 API 是否通

curl https://integrate.api.nvidia.com/v1/chat/completions \

-H "Authorization: Bearer nvapi-你的KEY" \

-H "Content-Type: application/json" \

-d '{"model":"moonshotai/kimi-k2.6","messages":[{"role":"user","content":"你好,用一句话介绍自己"}]}'

# 2. 启动 DeepSeek TUI

deepseek

# 3. 进入 TUI 后,输入第一句话测试

# "帮我分析当前目录的代码结构"看到 TUI 界面正常回复,说明一切就绪。

3.6 五种交互模式速览

DeepSeek TUI 的核心亮点是内置了五种交互模式,按 Tab 键循环切换:

四、实战案例:用 Kimi K2.6 分析项目代码

假设你有一个 Node.js 项目目录,想快速了解项目结构和潜在问题。

# 进入项目目录

cd ~/my-node-project

# 启动 DeepSeek TUI(使用 kimi profile)

deepseek --profile kimi进入 TUI 后,可以这样交互:

👤 你:阅读当前目录的 package.json,告诉我这个项目有哪些依赖,有没有已知的安全漏洞或废弃包Kimi K2.6 会读取文件、分析依赖,然后给出详细的清单——整个过程都是在终端里完成的,不用切换到浏览器或 IDE。

再进一步——进入 Plan 模式(按 Tab 切换):

👤 你:帮我规划一个任务——把当前项目中所有的回调函数改成 async/await 写法。先分析需要改动的文件,列出计划,等我确认后再执行AI 会先列出所有涉及的文件、预估改动范围,等你确认后再自动逐文件修改。这种「Plan → Review → Execute」的工作流非常适合项目级代码重构。

五、避坑指南

令牌无效(401) :检查 API Key 是否以

nvapi-开头,NIM Key 与 DeepSeek 官方 Key 格式不同权限拒绝(403) :部分用户首次调用 DeepSeek V4 Pro 等热门模型时会遇到此错误,说明组织缺少 Public API Endpoints 权限。去 NVIDIA 开发者论坛发帖申请开通即可

模型高负载(timeout) :Kimi K2.6 Thinking 和 DeepSeek V4 Pro 等热门模型高峰期可能超时无法连接,此时可以降级用 Flash 版,或稍等片刻重试

429 限流错误:免费层限制 40 RPM,如果触发,TUI 会自动退避重试,但建议适当控制请求频率

MISSING_COMPANION_BINARY:两个二进制文件必须同时安装——

deepseek和deepseek-tui:npm install -g deepseek-tui deepseek-tui-cliNVIDIA NIM 的 max_tokens 上限约 4096,需要长输出时可能会被截断。对于需要更长回复的场景,建议拆分成多次对话

base_url 末尾不要带额外路径,正确写法是:

https://integrate.api.nvidia.com/v1不要写成

/v1/chat/completions。

总结

这套组合的核心价值很明确:用免费的算力跑顶级的模型,同时享受原生终端编码体验。DeepSeek TUI 让编码 Agent 直接嵌入命令行,免去 IDE 开销;NVIDIA NIM 让 Kimi K2.6、DeepSeek V4 Pro 这些模型完全零成本可用。

对于日常开发中的代码分析、重构、项目初始化等场景,这套方案完全够用。不妨今天就花几分钟搭起来,让终端里多一位随时待命的 AI 编码伙伴。